Autonomous Navigation Lab., Department of Electrical and Computer Engineering, Inha University, Incheon 22212, Korea

†Corresponding Author: Jong-Hoon Won, E-mail: jh.won@inha.ac.kr

Citation: Kang, I.-S., Im, J.-U., & Won, J.-H. 2026, UAV Place Recognition Method with Solid-State LiDAR, Journal of Positioning, Navigation, and Timing, 15, 55-62.

Journal of Positioning, Navigation, and Timing (J Position Navig Timing) 2026 March, Volume 15, Issue 1, pages 55-62. https://doi.org/10.11003/JPNT.2026.15.1.55

Received on Dec 30, 2025, Revised on Jan 24, 2026, Accepted on Feb 12, 2026, Published on Mar 15, 2026.

Copyright © The Institute of Positioning, Navigation, and Timing

License: Creative Commons Attribution Non-Commercial License (https://creativecommons.org/licenses/by-nc/4.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

Autonomous driving technologies have been studied across diverse platforms and environments, and localization remains an important task in this field. Although Global Navigation Satellite System (GNSS)-based navigation is commonly used, its performance can degrade due to its dependency on radio signals. This limitation motivates the need for radio-free, sensor-based navigation methods. In this work, we present a Light Detection and Ranging (LiDAR)-based place recognition method designed for Unmanned Aerial Vehicles (UAVs) rather than ground vehicles that can be used as loop-closure detection and re-localization. The proposed method includes a preprocessing step, a feature extraction and descriptor computation approach, and a voting-based candidate matching method. Finally, the proposed method is validated using real-world UAV flight datasets to demonstrate its effectiveness.

UAV, LiDAR, localization, place recognition

전통적으로 자율 이동체는 물체의 감지 및 분류를 수행하는 인지, 지역 및 전역 경로 계획을 수행하는 판단, 이동체에 대한 제어 등의 기능을 수행한다. 특히, 해당 기능들의 성공적 운용을 위해서는 자율 이동체의 위치를 정확히 추정해야 한다. 전통적으로 Global Navigation Satellite System (GNSS)를 기반으로 한 위치 추정 기법이 우선적으로 고려되었으며, 이는 위성항법을 통한 측위가 높은 정확도를 갖기 때문이다. 그러나, 이러한 GNSS의 운용은 전파의 수신을 방해받거나 제약되는 환경에서 그 신뢰도가 떨어진다. 즉, Jamming, Spoofing과 같은 상황에 노출되거나 (Radoš et al. 2024), 도심지 환경에서 다중 경로 오차 문제를 겪을 수 있다 (Ahmed et al. 2023). 또한, 태양 활동으로 인한 위성 시스템의 오류나 (Sreeja 2016) 인공위성이 없는 외행성 환경에서 운용이 불가한 상황도 존재한다 (Cheung et al. 2024). 이러한 문제들을 해결하기 위해 Inertial Measurement Unit (IMU), 카메라, Light Detection And Ranging (LiDAR) 등의 센서를 통한 비전파 기반의 항법들이 연구되었다 (Gao et al. 2023). 특히, 카메라와 LiDAR 등 주변 환경에 대한 장면을 취득하는 센서를 기반으로 한 위치 추정 기법은 크게 이전 프레임과 현재 프레임 간의 매칭을 통해 병진 및 회전의 상대 이동을 추정하는 Odometry 기법과 (Mohamed et al. 2019), 미리 구축한 장면에 대한 Database (DB)와의 매칭을 통해 절대 위치를 추정하는 장소 인식 기반 기법으로 분류된다 (Li et al. 2025). 이때 카메라는 장면에 대한 풍부한 텍스쳐 정보를 제공하나 조도와 날씨의 변화에 취약하다. 반면, LiDAR는 기하학적 정보를 직접 취득할 수 있어 상대적으로 조도 및 기상 변화에 강건하다 (Zhuang et al. 2021).

먼저, 지상 이동체에 대한 장소 인식 기법 연구는 다음과 같다. He et al. (2016)은 3차원 점 군을 여러 2D 평면에 투영하여 장면을 표현한 M2DP를 제안했다. 해당 기법에서는 여러 2D 평면에 투영한 점 군이 극좌표계 Bin에 얼마나 있는지 세며 Signature Matrix를 생성한 후 Singular Vector Decomposition (SVD)를 통해 전역 설명자를 추출했다. 이는 빠른 연산과 희소 점 군에 적용 가능하다는 장점을 가지나 시점 변화에 대해 완전한 불변성을 보장하지 못한다는 한계를 가진다. Kim & Kim (2018)은 높이 정보를 활용하여 장소 인식에 활용하는 Scan Context를 제안했다. 이는 극좌표계 Bin에서 최고점의 높이를 추출하여 전역 설명자를 만든 뒤 이러한 설명자를 축약한 Ring Key를 통해 K-dimensional Tree에서 후보를 탐색하는 방식을 취했다. 또한, 설명자의 열을 이동하며 코사인 유사도를 계산하여 회전에 불변한 특성을 갖고자 하였다. 해당 기법은 장면의 구조적 정보를 보존하여 높은 구별력을 가진다는 장점을 가지나 병진 이동에 대한 불변성을 보장하지 못한다. Zhang et al. (2024)은 특징점 주변 객체 점들의 분포를 지역 설명자로 삼은 투표 기반 장소 인식 기법인 Occupancy Set Key를 제안했다. 해당 기법에서는 복셀화를 통해 포함하는 지면 제거 기법을 적용한 후 객체가 있는 영역에서 특징점을 추출한다. 이후 특징점 주변을 극좌표계를 기준으로 주변 객체 점들의 ID를 담아 ID 집합을 Hash 함수로 변환하여 지역 설명자로 저장하였다. 이러한 특징점을 통해 투표 기반의 매칭을 수행하였다. 이는 병진 이동 변화에 강건하다는 장점을 가지나 구조적 변별력이 낮은 환경에서 성능이 저하될 수 있다는 한계를 가진다.

다음으로, 비행체에 대한 위치 추정 연구는 다음과 같다. Hemann et al. (2016)은 Error-state Kalman Filter에 대해 2D LiDAR와 IMU의 센서융합을 통한 헬기의 위치 추정 기법을 제안했다. 이를 위해, IMU Odometry를 수행하고 누적되는 오차를 해소하기 위해 LiDAR로 스캔한 지형을 누적하여 지역적 높이 지도를 만든 뒤 이를 지형의 높이 정보가 저장된 Digital Elevation Model (DEM)과 Normalized Cross-Correlation을 기준으로 매칭했다. 해당 기법은 장거리 비행 시나리오에서 LiDAR를 통해 위치 추정 오차를 개선하였으나, 2D LiDAR 스캔을 누적하는 방식에 의존하여 급격한 자세 변화가 발생하는 비행 환경에서는 제약이 따른다는 한계를 가진다. Zhang et al. (2025)은 SURF 및 SIFT 기반의 특징점 추출을 토대로 실시간으로 취득한 점 군을 통해 생성한 DEM과 주어진 지형에 대한 DEM 특징점 대응 관계를 알아내어 관성 항법에 통합하는 방식으로 위치를 추정했다. 이는 SIFT와 SURF 방식을 혼용하여 정확도와 속도 간의 균형을 맞추었으나, 장면 내의 동적 객체에 대한 고려가 부족하다는 한계가 있다. 마지막으로, Im & Won (2025)은 Hemisphere LiDAR를 사용하여 게임 엔진을 기반으로 한 가상 환경에서 장소 인식을 활용한 UAV 위치 추정 기법을 제안했다. 이를 위해 고도 기반의 특징점 추출 기법과 거리를 요소로 한 지역 설명자와 전역 설명자의 생성 기법을 제시하며, 기하학적 검증과 자세 추정을 위한 히스토그램 기반의 점 군 정합 기법을 제안했다. 해당 연구는 장소 인식을 기반으로 Advanced Air Mobility 환경에서의 강건한 위치 추정 기법을 체계적으로 제시했으나, 실제 비행 데이터셋에서의 검증을 수행하지 않았다.

본 논문은 비반복적 레이저 패턴을 가진 Solid-State LiDAR를 활용한 UAV의 장소 인식 알고리즘을 제안한다. 이는 3차원 점 군을 높이 정보로 축약함에 따라 기하학적 정보의 손실이 발생하는 기존의 DEM 방식과 대조적으로 3차원 점 군의 분포를 직접 활용하는 설명자 기반의 항법 알고리즘이다. 제안하는 기법은 Solid-State LiDAR를 UAV에 하향 부착하여 장면을 취득하고 지상 이동체와 달리 플랫폼의 자세가 역동적으로 변하는 상황을 가정한다. 전통적인 회전형 LiDAR의 경우 제한된 수직 Field of View (FoV)로 인해 UAV 자세의 변화 시 일관된 형상을 취득하기 어렵다는 제약이 생긴다. 또한, Hemisphere LiDAR의 경우 센서의 탐지 거리가 짧아 비행체의 위치 추정에 운용하기 어렵다는 한계를 갖는다. 반면, 제안하는 기법에서 활용하는 하향 부착된 Solid-State LiDAR의 경우 상대적으로 일관된 점 군을 취득할 수 있다는 장점을 갖는다. 이러한 LiDAR 선정에 더불어 본 연구에서는 UAV 자세 변화와 비반복적 레이저 패턴을 보완하고자 수평화와 Region of Interest (RoI)의 선정 과정을 수행한다. 또한 설명자 생성 단계에서 매칭 단계에서 지역 설명자의 구별력을 높이고자 이중 반경 구조를 설계하였으며, 지역 설명자를 통한 장소 후보군 선정에서 투표 방식의 기법을 적용한다. 제안하는 장소 인식 연구는 GNSS 불능 상황에서 UAV 항법의 생존성을 강화하고자 하며, 상대적 위치 변화를 추정하는 Odometry 기법이 제공하지 못하는 지구 상의 좌표를 추정할 수 있다. 이는 Simultaneous Localization and Mapping (SLAM) 프레임워크 상의 루프 폐쇄 검출(loop closure detection) 또는 플랫폼이 위치 추정에 실패했을 때 위치를 다시 추정하거나 시스템의 시작 단계에서 초기 위치를 추정하는 상황에서의 재위치화(relocalization) 절차에서 활용될 수 있다.

본 논문의 구성은 다음과 같다. 2장에서는 제안하는 장소 인식 기법을 설명하며, 3장에서는 성능 평가를 위한 실험 환경의 구성과 평가 결과를 제시한다. 4장에서는 본 연구의 결론과 추후과제를 논의한다.

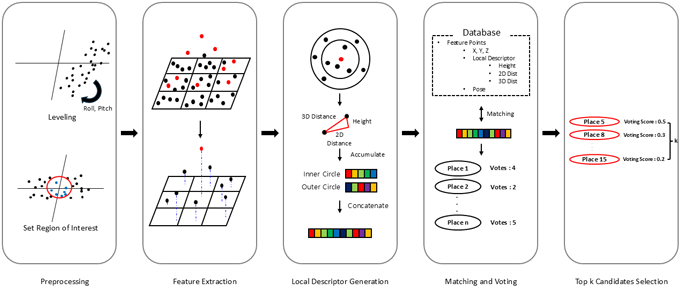

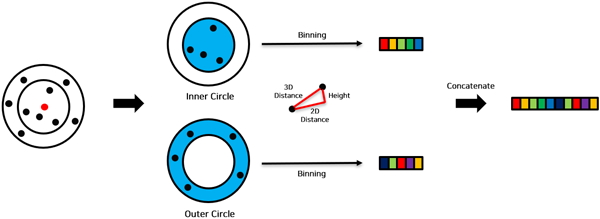

본 논문은 UAV에 하향 부착된 Solid-State LiDAR로부터 취득한 점 군을 통해 장소 인식을 수행한다. 이때, 비반복적 레이저 패턴을 가진 LiDAR를 고려한다. Fig. 1은 제안하는 기법의 전체 구성을 보여준다. 본 연구에서는 전처리 과정에서 UAV 비행 간에 생기는 Roll, Pitch에 의해 점 군이 기울어지는 현상을 보정하고 비반복적 레이저 패턴을 고려하여 RoI를 취득한다. 또한, 특징점 추출 과정에서 Im & Won (2025)이 제안한 Omni Point Air의 방식을 따라 최고점을 토대로 한 두 단계의 특징점 추출 방식을 따른다. 이러한 두 단계에 걸친 특징점 추출 과정으로 장면에서 특징이 되는 점 만을 추출하여 연산 복잡도를 줄이고 매칭의 강건성을 개선하고자 하였다. 이후 지역 설명자 생성 과정에서 각 특징점에 대해 안쪽과 바깥쪽 반경을 설정하는데 이때, Im & Won (2025)이 제안한 거리 기반의 3가지 요소에 대해 Binning을 수행하여 히스토그램 형태의 설명자를 생성한다. 이를 통해 매칭 간에 설명자의 구별성을 높이고자 하였으며, 거리 기반의 요소를 사용함으로써 회전과 병진에 불변하는 특성을 갖도록 한다. 마지막으로, DB와의 매칭 과정에서 매칭된 지역 설명자를 투표하는 방식으로 매칭 점수를 산출하여 장소 후보군을 선정한다.

Fig. 1. Overall pipeline of the proposed place recognition algorithm.

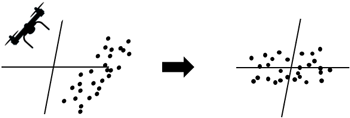

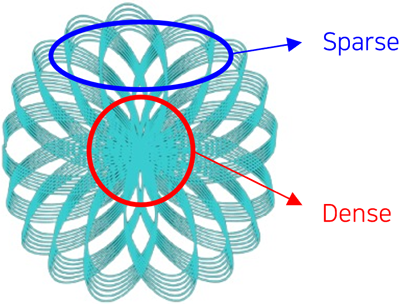

점 군을 취득한 이후에 전처리 과정에서 점 군의 수평화(leveling)를 수행하고 RoI를 설정한다. 먼저, 점 군의 수평화 절차를 수행한다. 지상 이동체와 달리 UAV의 비행 간 플랫폼의 자세가 지표면과 완전히 수평을 이루지 않아 LiDAR로 부터 취득한 점 군 또한 같이 기울어진다. 이 때문에 점 군의 중심 좌표가 원점에서 멀어지고 그 형상 또한 기울어진다. 이를 보완하기 위해 LiDAR 점 군을 IMU 좌표계로 변환해 준 뒤 IMU로부터 취득한 Roll, Pitch 값을 통해 구성한 회전 행렬을 통해 점 군을 회전한다. Fig. 2는 점 군에 대한 수평화 절차를 보여준다. 이러한 수평화 절차를 거칢으로써 이후 모듈에서 수행되는 최고점 기반의 특징점 추출 과정과 설명자 생성 시에 활용되는 원통형 구간을 온전히 활용할 수 있도록 한다. 다음으로, 수평화된 점 군에 대해 RoI를 설정한다. 이는 점 군에서 유의미한 일부 영역만을 추출하는 과정으로, 제안하는 기법이 비반복적 레이저 패턴의 점 군을 고려하기 때문에 수행되는 절차다. 일반적으로 비반복적 레이저 패턴의 점 군을 운용할 경우, 한 프레임으로 취득한 점 군이 모든 영역을 일정하게 취득하지 못하므로 여러 프레임에서 취득한 점 군을 정합하여 누적하는 방식을 사용한다. 그러나 이러한 정합 기법은 연산 복잡도가 높아 실행 시간을 대폭 증가시킨다. 따라서 본 연구에서는 연산 복잡도를 줄이기 위해 단일 프레임만을 사용하는 대신 점 군의 밀도가 높은 원점 부근의 영역을 RoI로 설정한다. 비반복적 레이저 패턴 내에서 점 군의 밀도가 다른 이유는 레이저의 발사 순서(firing sequence) 상 원점 부근의 영역은 여러 차례 지나가기 때문이다. 이로 인해 전반적으로 점 군이 희소하지만 원점 부근에서는 상대적으로 높은 밀도의 점 군이 취득된다. Fig. 3은 이러한 레이저 패턴 내 점 군의 밀도의 차이를 보여준다.

Fig. 2. Conceptual illustration of the point cloud leveling process.

Fig. 3. Density distribution across regions under the non-repetitive laser scanning pattern.

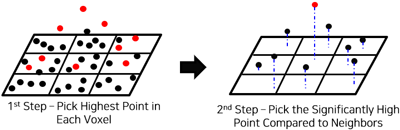

전처리 과정을 거친 점 군에 대해 Omni Point Air의 방식으로 특징점을 추출한다 (Im & Won 2025). Fig. 4는 Omni Point Air의 특징점 추출 방식을 설명하는 그림이다. 해당 기법에서는 장면 내에서 최고점을 추출하기 위해 두 단계의 과정을 거친다. 먼저, 점 군에 대해 데카르트 좌표계 기반의 복셀화를 거친 후, 각 복셀 내 최고점을 추출한다. 이후, 복셀을 탐색하며 복셀 내 최고점이 이웃 복셀의 최고점보다 상대적으로 큰 정도로 높은지 확인한다. 이를 위해 미리 정의된 문턱값 이상으로 높은 경우를 세며 그 수가 어느 정도인지를 기준으로 최종적인 특징점을 선정한다. 이러한 최고점 기반의 특징점 추출 방식은 UAV 운용 시 장면에서 장기간 동일 위치에 머무는 정적 객체를 선별하는데 유효하다. 해당 연구에서는 이에 더해 두 단계의 선별 과정을 거쳐 장면에서 유의미하게 높은 점들을 특징점으로 선정하였다.

Fig. 4. Feature extraction procedure of Omni Point Air.

취득한 특징점에 대한 지역 설명자를 생성한다. Fig. 5는 제안하는 지역 설명자 생성 기법을 나타낸다. 본 연구에서는 각 특징점에 대해 미리 정의된 크기로 안쪽과 바깥쪽 반경을 설정한다. 이후 안쪽 반경 내 원형 영역과 안쪽 반경과 바깥쪽 영역 사이에 있는 고리 형태의 영역 내의 특징점들을 순회하며 Binning을 수행한다. 이때 Binning의 방식으로 Omni Point Air에서 지역 설명자를 생성하던 방식을 따른다 (Im & Won 2025). 즉, 높이, 2차원 거리, 3차원 거리에 대한 히스토그램을 개별적으로 생성하고 3가지 히스토그램을 이어 붙인다. 제안하는 기법에서는 이러한 과정을 안쪽 반경과 바깥쪽 반경 영역에 대해 각각 수행하여 나온 벡터를 마지막에 이어 붙여 지역 설명자로 삼는다.

Fig. 5. Flowchart of the proposed local descriptor generation method.

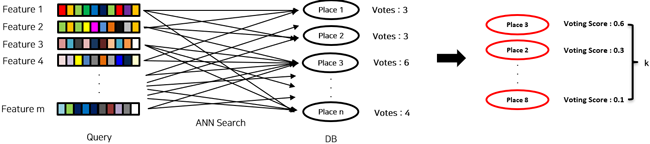

UAV 비행 간에 취득한 단일 장면 내 지역 설명자들과 미리 생성한 DB 내 지역 설명자를 매칭한다. Fig. 6은 제안하는 기법에서 지역 설명자를 매칭하는 과정을 보여준다. 제안하는 기법은 UAV에 대한 2차원으로 표현된 위치에 대한 추정을 목적으로 하여 DB 내 위치를 2차원으로 저장한다. DB 내에 주어진 환경의 여러 장면들에 대한 지역 설명자들이 저장되어 있다고 가정할 때, UAV가 비행하며 실시간으로 취득한 각 특징점들의 지역 설명자들이 DB 내 어느 지역 설명자와 매칭되는지 그 후보를 그래프 기반의 Hierarchical Navigable Small World (HNSW) 기법으로 탐색하였다 (Malkov & Yashunin 2020). 이를 통해 각 쿼리 지역 설명자는 일정 수의 지역 설명자 후보군에 매칭되어 이러한 지역 설명자 후보군이 포함된 장소에 대한 투표를 수행한다. 즉, 어떤 장소에 포함된 지역 설명자가 매칭되었을 경우 그 장소에 대한 표를 증가시킨다. 이후 가장 많은 투표를 받은 k개의 장소 후보를 선정한다. 마지막으로, 이러한 k개의 장소 후보가 받은 투표 수를 쿼리 지역 설명자의 개수로 나눠 정규화하고 이를 각 장소에 대한 매칭의 신뢰도 지표로 활용한다.

Fig. 6. Illustration of the local descriptor matching process.

제안하는 장소 인식 기법은 Li et al. (2024)이 제시한 MaRS-LVIG 데이터셋을 통해 성능을 검증하였다. 해당 데이터셋은 실제 UAV로 4가지 환경에서 일정 고도로 비행하며 카메라 및 LiDAR, IMU, Global Positioning System (GPS) 등에서 취득한 데이터를 제공한다. 이때, LiDAR의 경우 Livox 사의 Solid-State LiDAR인 Avia를 하향 부착하여 운용하였으며, 이는 비반복적 레이저 패턴을 가졌다. 본 연구에서는 해당 데이터셋에서 제공하는 공항, 섬, 시골 마을, 협곡 중 시골 마을에 해당하는 데이터셋 3개를 활용하며, 이는 80 m 고도에서 4 m/s, 8 m/s, 12 m/s의 속도로 비행하는 데이터셋이다. 이러한 시골 마을 환경은 민가에 위치하여 인공 구조물과 나무와 같은 자연물이 균형 있게 배치되어 있어 장소 인식 능력을 평가하기에 적절하다. Fig. 7은 이러한 시골 마을 환경의 예시를 보여준다. 제안하는 기법은 해당 환경에서 M2DP와 Scan Context, Occupancy Set Key 기법에 대해 비교 검증을 수행하였다.

Fig. 7. Rural town flight environment in the MaRS-LVIG dataset.

본 연구에서는 3가지 비행 데이터셋 중 4 m/s 비행 데이터셋을 5 m 간격으로 샘플링하여 DB를 구축하였다. 이때, Ground Truth 위치를 Real-Time Kinematic (RTK)을 통해 보정한 GPS 측정값으로 설정하였다. 또한, 넓은 장면을 포괄해야 하는 전역 설명자 방식과의 비교를 위해 모든 기법에서 80 m의 RoI를 설정하였다. DB와의 매칭 과정에서 OSK의 경우 원문의 방식을 따랐으나 제안하는 기법과 M2DP 및 Scan Context는 Faiss (Johnson et al. 2021) 기반의 HNSW 탐색을 수행하였다. 이때 Scan Context의 경우 UAV에서 하향 관측된 점 군이 원문의 Ring Key 방식으로 충분한 구별력을 확보하기 어려운 점을 보완하기 위해 Faiss 기반의 매칭으로 대체하였다.

모든 실험은 Intel i7-13700K, NVIDIA GeForce RTX 3070Ti를 연산 환경으로 운용하여 수행되었다. 3.2절에서는 설명자의 성능을 검증하기 위해 비행 데이터셋 전반과 비행 궤도 구간 별 Recall@k를 측정하였다. 또한, 3.3절에서는 장소 인식 성능의 검증을 위해 Precision-Recall과 Average Precision 및 최대 F1-Score를 측정했다.

본 절에서는 설명자의 성능을 측정하기 위해 속도 별 비행 데이터셋에 대한 Recall@k 성능을 검증한다. Table 1은 서로 다른 장소 인식 기법에 대해 Top-1, Top-5, Top-10에 대한 후보를 선정하여 임계값을 10 m, 20 m, 40 m로 설정하여 Recall@k를 측정한 결과이다. 실험 결과 제안하는 기법이 모든 경우에서 다른 기법 대비 성능이 우수하였으며, 가장 조건이 엄격한 Top-1의 임계값 10 m 조건에서도 Recall@k가 0.6988로 양호하였다. 이때 M2DP와 Scan Context의 경우 OSK 대비 매칭이 잘 수행되는데 이는 해당 기법들의 설명자가 장면의 구조를 잘 담고 있음을 보여준다. 반면, OSK는 특징점의 추출 과정에서 평가 데이터셋에서 사용한 LiDAR의 비반복적 레이저 패턴으로 인해 장면의 특징적 영역이 아닌 레이저 패턴 상 밀도가 높은 영역을 추종하는 형태로 특징점을 추출하여 매칭에서 빈번히 실패하였다.

Table 1. Recall@k for place recognition methods.

| Sequence | Method | Top-1 | Top-5 | Top-10 | ||||||

|---|---|---|---|---|---|---|---|---|---|---|

| 10 m | 20 m | 40 m | 10 m | 20 m | 40 m | 10 m | 20 m | 40 m | ||

| AMtown02 (8 m/s) | M2DP | 0.2023 | 0.2479 | 0.2820 | 0.3411 | 0.4060 | 0.4578 | 0.3997 | 0.4744 | 0.5374 |

| SC | 0.0695 | 0.1119 | 0.1660 | 0.1913 | 0.2512 | 0.3205 | 0.3153 | 0.3819 | 0.4524 | |

| OSK | 0.0347 | 0.0377 | 0.0467 | 0.0364 | 0.0440 | 0.0745 | 0.0377 | 0.0508 | 0.0874 | |

| Proposed | 0.6988 | 0.8513 | 0.8780 | 0.8983 | 0.9053 | 0.9081 | 0.9065 | 0.9138 | 0.9157 | |

| AMtown03 (12 m/s) | M2DP | 0.1053 | 0.1385 | 0.1608 | 0.1970 | 0.2664 | 0.3091 | 0.2637 | 0.3545 | 0.4119 |

| SC | 0.0361 | 0.0583 | 0.0866 | 0.0955 | 0.1400 | 0.1858 | 0.1685 | 0.2011 | 0.2363 | |

| OSK | 0.0646 | 0.0766 | 0.1142 | 0.0806 | 0.1051 | 0.1564 | 0.1029 | 0.1322 | 0.1777 | |

| Proposed | 0.5164 | 0.7887 | 0.8358 | 0.8510 | 0.8755 | 0.8830 | 0.8729 | 0.8900 | 0.8959 | |

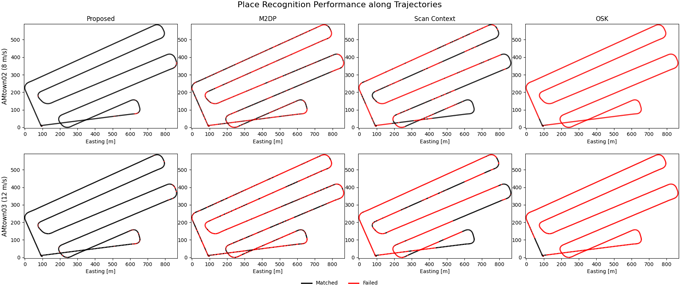

먼저, 전체 궤적에서 Top-10의 후보를 선정하여 40 m의 임계값을 설정하여 Recall@10을 기준으로 매칭 성공 여부를 측정하였다. Fig. 8은 속도별 비행 데이터셋에 대한 각 장소 인식 기법의 매칭 성공 여부를 궤적 상에 나타낸다. 이때, 검은색으로 나타난 곳은 매칭에 성공한 곳이고 붉은색으로 나타나는 구간은 매칭에 실패한 영역이다. 실험 결과 제안하는 기법이 대부분의 영역에서 매칭에 성공하는 것을 확인할 수 있으며, M2DP의 경우 직선 구간과 회전 구간에서 균형 있게 매칭에 성공하였다. 또한 Scan Context의 경우 수치적으로 M2DP에 대비 전체 매칭 성공률이 낮았지만 연속적으로 성공한 구간의 길이는 M2DP보다 긴 것을 확인할 수 있었다. OSK는 전반적으로 설명자 매칭에서 실패하였으나 초기 구간에서는 매칭이 잘 되는 것을 알 수 있었다. 이를 분석한 결과 OSK는 비행 궤적의 전 구간에서 대부분 초기 프레임에만 매칭되는 현상을 확인하였고 이로 인해 실제 그 구역을 지나갈 때는 매칭이 성공했지만 나머지 구역에서는 매칭에 계속해서 실패한 것으로 확인됐다. 이는 초기 프레임들에서 일반적으로 장면에 빈번하게 포함되는 지역 설명자가 많이 분포하여 이러한 장면들에 계속해서 투표되면서 실질적인 구별력을 잃어 매칭이 이뤄지지 않는 현상이다.

Fig. 8. Visualization of successful and failed matches along the flight trajectories.

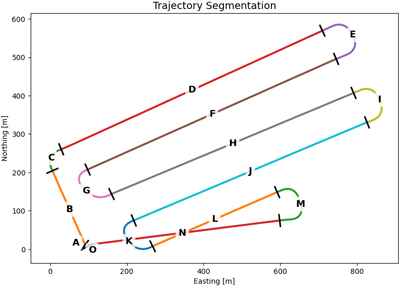

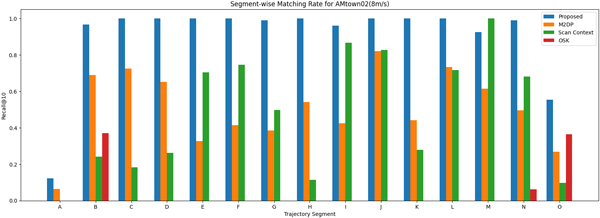

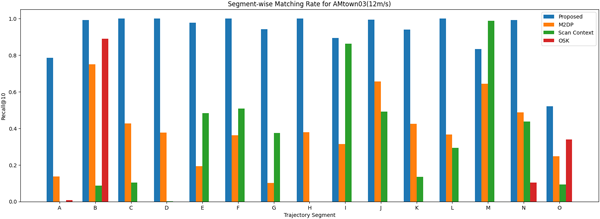

다음으로, 비행 궤적을 구간으로 나누어 이러한 매칭 성공률을 측정하였다. Fig. 9는 구간 별 매칭 성공률을 측정하기 위해 나눈 비행 궤적의 구간을 보여준다. 본 연구에서 사용한 데이터셋은 크게 이착륙 구간과 직선 비행 구간, 회전 비행 구간으로 나뉜다. 이때 Fig. 9에서 이착륙 구간은 A와 O이고, 직선 비행 구간은 B, D, F, H, J, L, N이며, 회전 비행 구간은 C, E, G, I, K, M에 해당한다. Figs. 10과 11은 각각 8 m/s와 12 m/s 데이터셋에서 비행 구간별 장소 인식 매칭 성공률을 보여준다. 실험 결과 모든 기법에서 이착륙 구간인 A와 O 구간에서 매칭 성공률이 낮은 것을 확인할 수 있다. 이는 근본적으로 UAV 고도가 매우 낮은 상황에서는 하향 관측하는 LiDAR의 특성 상 점 군의 FoV가 작아지고 유의미한 장면을 담을 수 없기 때문이다. 이때 12 m/s 데이터셋에서 8 m/s 데이터셋에서 보다 매칭이 잘 수행된 이유는 해당 데이터셋에서 이륙 후 제자리에 머무는 시간이 길기 때문이다. 또한 모든 기법에서 상대적으로 착륙 구간이 이륙 구간보다 성공률이 높은 이유는 착륙 시간이 훨씬 짧아 유의미한 장면을 추출하지 못하는 프레임이 적기 때문이다. 제안하는 기법의 경우 직선 구간에서 매칭이 잘 되고 회전 구간에서 상대적으로 매칭 성공률이 낮아지는 경향이 있었는데 이는 회전 구간에서 UAV의 자세가 기울어지며 DB 상의 현재 위치에서 하향 관측하며 취득한 장면과 다른 장면을 취득하기 때문이다. 그러나 전역 설명자 기법인 M2DP와 Scan Context의 경우 이러한 경향이 두드러지지 않았고 개별 설명자들로 인해 달라지는 장면에 대한 구별 능력이 매칭 성공률에 더 큰 영향을 주었다. 이때, M2DP의 경우 Scan Context 대비 전반적인 매칭 성공률의 편차가 적어 일반화 능력이 더 뛰어났다. 그러나 최대 매칭 성공률은 Scan Context가 M2DP보다 더 높아 일부 조건에서는 Scan Context가 더 우수한 성능을 보임을 알 수 있었다. 또한, 전반적으로 모든 기법들이 속도가 낮은 8 m/s 데이터셋에서 12 m/s 데이터셋보다 매칭 성공률이 높은 것을 확인할 수 있었으며, 이는 회전 구간에서와 마찬가지로 UAV 자세가 기울어지며 지표면과 수평한 장면을 일관되게 취득하지 못하기 때문이다.

Fig. 9. Visualization of trajectory segments for performance analysis.

Fig. 10. Segment-wise matching rate on the 8 m/s dataset.

Fig. 11. Segment-wise matching rate on the 12 m/s dataset.

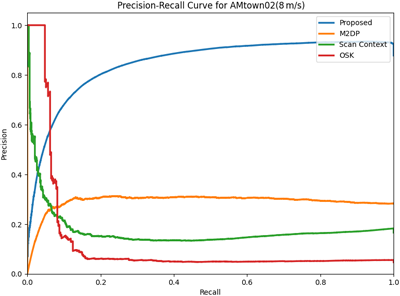

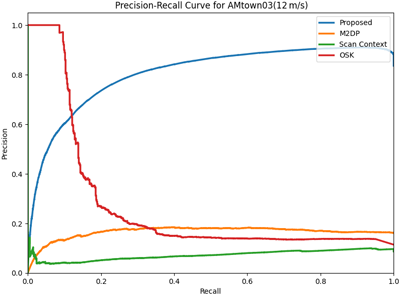

본 절에서는 최종 장소 후보를 선정한 결과를 토대로 장소 인식의 성능을 Precision-Recall과 Average Precision 및 최대 F1-Score로 검증한다. Figs. 12와 13은 각각 8 m/s와 12 m/s 비행 데이터셋에 대해 각 장소 인식 기법의 Precision-Recall을 측정한 그래프이다. 실험 결과 제안하는 기법이 다른 기법 대비 우수한 성능을 보임을 알 수 있었다. 이는 제안하는 기법이 Roll, Pitch 변화에도 지역 설명자를 기반으로 투표를 수행하여 장면의 겹치는 구간을 포착하며 매칭을 수행할 수 있지만 전역 설명자 기법인 M2DP와 Scan Context의 경우 일관된 장면을 취득하지 않으면 장소 인식을 수행하기 어렵기 때문이다. 이때 OSK의 경우 지역 설명자 기법으로 이러한 조건에서 더 강건할 것으로 생각되었으나 특징점 추출 과정에서 비반복적 레이저 패턴에 대응하지 못하면서 그러한 이점을 살릴 수 없었다. 또한 이전 실험 결과에서 궤적의 구간별로 분석한 결과와 마찬가지로 M2DP가 Scan Context 대비 안정적인 Precision-Recall 그래프를 보이며 일반화 능력은 더 높다는 점을 알 수 있었다. 그리고 이전 실험에서의 분석과 마찬가지로 OSK를 제외한 기법들에서 전반적으로 저속 상황에서 성능이 더 우수한 것을 확인했다. Table 2는 이러한 Precision-Recall 그래프를 토대로 Average Precision과 최대 F1-Score로 장소 인식의 성능을 측정한 결과다. 표를 통해 수치적으로도 제안하는 기법이 최대 0.8465의 Average Precision을 달성하고 최대 F1-Score에서는 최대 0.9607을 달성하여 다른 기법 대비 우수한 성능을 보임을 확인할 수 있었다.

Fig. 12. Precision-Recall curves for the place recognition methods on the 8 m/s dataset.

Fig. 13. Precision-Recall curves for the place recognition methods on the 12 m/s dataset.

Table 2. Average precision and maximum F1-Score for place recognition methods.

| Sequence | Method | Average precision | Maximum F1-score |

|---|---|---|---|

| AMtown02 (8 m/s) | M2DP | 0.2913 | 0.4413 |

| SC | 0.1762 | 0.3086 | |

| OSK | 0.1205 | 0.1327 | |

| Proposed | 0.8465 | 0.9607 | |

| AMtown03 (12 m/s) | M2DP | 0.1650 | 0.2838 |

| SC | 0.0723 | 0.1798 | |

| OSK | 0.2686 | 0.2414 | |

| Proposed | 0.8050 | 0.9405 |

본 논문은 GNSS 불능 상황에서 UAV의 항법 생존성을 높이는 Solid-State LiDAR 기반의 장소 인식 기법을 제안하였다. 제안하는 기법은 전처리 절차와 특징점 추출 및 설명자 연산 기법, 투표 기반의 매칭 기법을 포함하였다. 이러한 기법을 실제 UAV 비행 데이터셋으로 검증하여 Average Precision 및 최대 F1-Score에서 최대 0.8465와 0.9607을 달성하며 타 기법 대비 UAV에 대한 LiDAR 기반의 장소 인식 성능에서 우수함을 입증하였다. 추후 과제로 UAV의 Roll, Pitch에 대응하여 LiDAR 점 군이 기울어지는 것을 근본적으로 보완하기 위해 짐벌을 부착한 LiDAR를 운용하며 장면의 취득을 더 일관되게 할 수 있을 것이다. 또한, 지역 설명자 매칭 과정에서 각 지역 설명자의 매칭 시 사용된 근사 최근접 탐색 기법에서의 기준 거리를 가중치로 사용한 매칭 방식을 고려할 수 있다. 마지막으로, 본 연구에서는 시골 마을 환경에서만 실험을 수행하였으나 추후 연구에서는 다른 환경에 대한 비행 데이터셋에서의 성능을 측정하여 장소 인식의 일반화 능력을 검증하고자 한다. 본 연구의 결과는 UAV를 비롯한 비행체가 임무를 수행할 때, GNSS 항법에 제약이 생기는 상황에서의 대안적 항법으로 활용되어 비행체의 항법 생존성을 높이는 기술로 활용될 수 있을 것이다.

이 논문은 2026년도 정부(산업통상자원부)의 재원으로 한국산업기술진흥원의 지원을 받아 수행된 연구임 (P0020536, 2026년 산업혁신인재성장지원사업).

Conceptualization, I.-S. Kang, J.-U. Im, and J.-H. Won; methodology, I.-S. Kang, J.-U. Im, and J.-H. Won; software, I.-S. Kang, J.-U. Im; validation, I.-S. Kang, J.-U. Im; formal analysis, I.-S. Kang, J.-U. Im; investigation, I.-S. Kang, J.-U. Im; resources, J.-H. Won; data curation, I.-S. Kang; writing—original draft preparation, I.-S. Kang; writing—review and editing, J.-H. Won; visualization, I.-S. Kang; supervision, J.-H. Won; project administration, J.-H. Won; funding acquisition, J.-H. Won.

The authors declare no conflict of interest.

Ahmed, M., Ballal, T., Liu, X., & Al-Naffouri, T. Y. 2023, Multipath Detection and Mitigation from GNSS Observations Using Antenna Arrays, IEEE/ION PLANS 2023. https://doi.org/10.1109/PLANS53410.2023.10139949

Cheung, K.-M., Jun, W. W., Bhamidipati, S., & Carter, P. 2024, Ground-assisted position navigation and timing (PNT) for moon and Mars, 2024 IEEE Aerospace Conference. https://doi.org/10.1109/AERO58975.2024.10520998

Gao, L., Xia, X., Zheng, Z., & Ma, J. 2023, GNSS/IMU/LiDAR fusion for vehicle localization in urban driving environments, Mechanical Systems and Signal Processing. https://doi.org/10.1016/j.ymssp.2023.110862

He, L., Wang, X., & Zhang, H. 2016, M2DP: A novel 3D point cloud descriptor and its application in loop closure detection, 2016 IEEE/RSJ IROS. https://doi.org/10.1109/IROS.2016.7759060

Hemann, G., Singh, S., & Kaess, M. 2016, Long-range GPS-denied aerial inertial navigation with LIDAR localization, 2016 IEEE/RSJ IROS. https://doi.org/10.1109/IROS.2016.7759267

Im, J.-U. & Won, J.-H. 2025, Omni Point Air: LiDAR and Point Cloud Map-Based Place Recognition and Pose Estimation for AAM, IEEE Transactions on Intelligent Vehicles. https://doi.org/10.1109/TIV.2024.3516791

Johnson, J., Douze, M., & Jégou, H. 2021, Billion-scale similarity search with GPUs, IEEE Transactions on Big Data. https://doi.org/10.1109/TBDATA.2019.2921572

Kim, G. & Kim, A. 2018, Scan context: Egocentric spatial descriptor for place recognition within 3d point cloud map, 2018 IEEE/RSJ IROS. https://doi.org/10.1109/IROS.2018.8593953

Li, H., Zou, Y., Chen, N., Lin, J., Liu, X., et al. 2024, MARS-LVIG dataset: A multi-sensor aerial robots SLAM dataset, The International Journal of Robotics Research. https://doi.org/10.1177/02783649241227968

Li, Z., Shang, T., Xu, P., & Deng, Z. 2025, Place recognition meet multiple modalities: a comprehensive review, Artificial Intelligence Review. https://doi.org/10.1007/s10462-025-11367-8

Malkov, Y. A. & Yashunin, D. A. 2020, Efficient and robust approximate nearest neighbor search using HNSW graphs, IEEE TPAMI. https://doi.org/10.1109/TPAMI.2018.2889473

Mohamed, S. A. S., Haghbayan, M.-H., Westerlund, T., Heikkonen, J., Tenhunen, H., et al. 2019, A survey on odometry for autonomous navigation systems, IEEE Access. https://doi.org/10.1109/ACCESS.2019.2929133

Radoš, K., Brkić, M., & Begušić, D. 2024, Recent advances on jamming and spoofing detection in GNSS, Sensors. https://doi.org/10.3390/s24134210

Sreeja, V. 2016, Impact and mitigation of space weather effects on GNSS receiver performance, Geoscience Letters. https://doi.org/10.1186/s40562-016-0057-0

Zhang, G., Zhou, J., Duan, Z., & Zhao, W. 2025, Research on LiDAR-Assisted Optimization Algorithm for Terrain-Aided Navigation of eVTOL, Sensors. https://doi.org/10.3390/s25185672

Zhang, Z., Huang, Y., Si, S., Zhao, C., Li, N., et al. 2024, OSK: A novel LiDAR occupancy set key-based place recognition method, IEEE Transactions on Instrumentation and Measurement. https://doi.org/10.1109/TIM.2024.3375408

Zhuang, Z., Li, R., Jia, K., Wang, Q., Li, Y., et al. 2021, Perception-aware multi-sensor fusion for 3d lidar semantic segmentation, 2021 ICCV. https://doi.org/10.1109/ICCV48922.2021.01597